Durante años, hablar de computación cuántica significó elegir entre dos extremos igual de poco útiles: la fantasía de máquinas que resolverían en segundos lo intratable, o el escepticismo que la trataba como una tecnología a veinte años vista sin aplicaciones tangibles. Entrando en 2026, con varias generaciones de hardware ya en producción, los primeros experimentos de corrección de errores a escala y una comunidad académica e industrial bastante más madura, conviene hacer una lectura honesta de dónde estamos. No es el momento de la revolución que prometía el marketing, pero tampoco es el desierto del escepticismo: hay progreso real, medible, y también límites que siguen siendo duros.

Dónde está el hardware a día de hoy

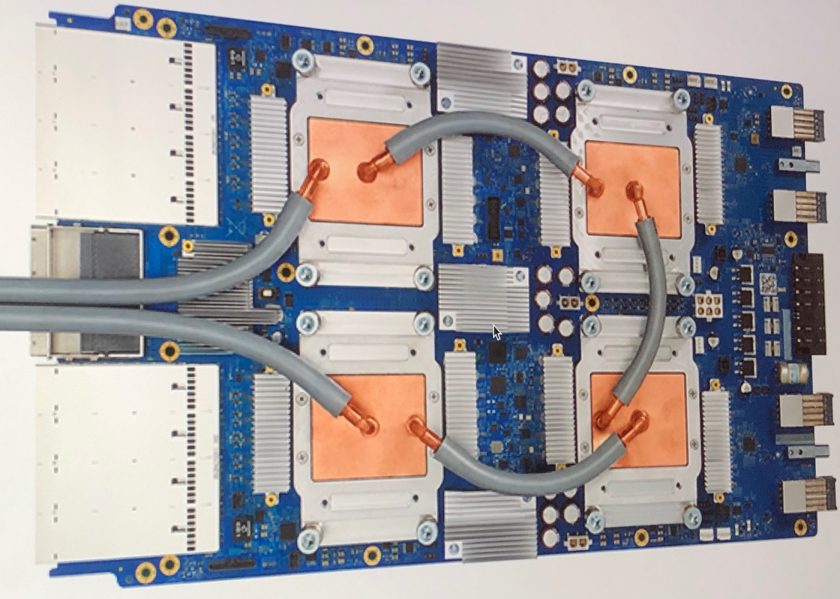

La métrica que dominaba los titulares hace cinco años era el número de cúbits físicos. IBM anunció su procesador Condor con 1121 cúbits a finales de 2023, Google presentó Willow con 105 cúbits en 2024 demostrando por primera vez corrección de errores por debajo del umbral, y en 2025 han aparecido varias generaciones más. Lo importante es que la comunidad ha abandonado la carrera estéril por el número bruto y ahora mide la calidad: fidelidad de puertas, tiempo de coherencia, conectividad del grafo de cúbits, y sobre todo la métrica que realmente importa en 2026, que es cuántos cúbits lógicos útiles se pueden construir a partir de esos físicos.

La diferencia entre físico y lógico es decisiva. Un cúbit físico es el dispositivo real, típicamente un circuito superconductor, un ion atrapado o un fotón, y tiene tasas de error altas: alrededor de una operación errónea por cada mil en los mejores sistemas actuales. Un cúbit lógico agrupa decenas o cientos de físicos bajo un código de corrección de errores, y su tasa de error efectiva puede ser órdenes de magnitud menor. El hito de Willow en 2024 fue demostrar que al añadir más cúbits físicos la tasa efectiva del cúbit lógico bajaba, no subía, cruzando por fin el umbral teórico después de décadas de trabajo. En 2026 varios laboratorios operan entre dos y diez cúbits lógicos, todavía lejos del centenar que hace falta para algoritmos útiles, pero ya en un régimen donde la mejora es cuestión de ingeniería incremental y no de descubrimientos fundamentales.

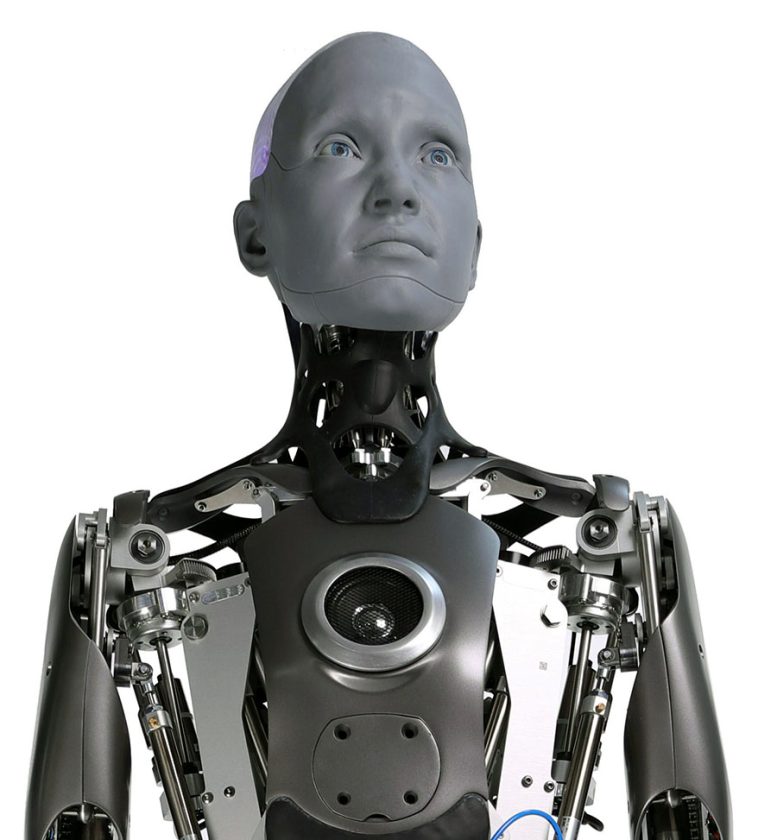

Los ecosistemas industriales relevantes siguen siendo los mismos de hace cinco años con una fusión notable: IBM con su familia Eagle, Condor y sucesores superconductores; Google Quantum AI con su hoja de ruta centrada en corrección de errores; Quantinuum, resultado de la fusión entre Honeywell y Cambridge Quantum, con iones atrapados que ofrecen fidelidades altísimas aunque con menos cúbits; IonQ y PsiQuantum como alternativas fotónicas. Microsoft, tras su apuesta por los cúbits topológicos, publicó en 2025 los primeros resultados verificados de partículas de Majorana que llevaban prometiendo desde 2018, aunque todavía a escala de pocos cúbits. Amazon Braket sigue ofreciendo acceso a varios de estos fabricantes a través de su servicio en la nube.

Qué algoritmos realmente funcionan

La parte más sobria de 2026 es reconocer que fuera de publicaciones académicas concretas, la computación cuántica aún no ha entregado ventaja sobre la clásica en ninguna aplicación de interés comercial general. El famoso experimento de supremacía cuántica de Google en 2019 resolvía un problema diseñado específicamente para ser difícil para un ordenador clásico, sin utilidad práctica. Las simulaciones de moléculas pequeñas han mejorado mucho pero siguen dentro del rango donde métodos clásicos como DFT o coupled cluster son competitivos o mejores. Los algoritmos de optimización tipo QAOA se comportan bien en puntos de referencia sintéticos pero empatan o pierden frente a heurísticas clásicas sofisticadas en problemas reales.

El nicho donde sí hay progreso medible es la simulación de sistemas cuánticos nativos. Simular la dinámica de un material magnético frustrado, un superconductor de alta temperatura o un sistema molecular con muchos electrones fuertemente correlacionados es un problema cuántico que los ordenadores clásicos abordan con aproximaciones costosas. Un procesador cuántico bien diseñado puede mapear el problema casi directamente, y en 2025 aparecieron los primeros experimentos donde máquinas con decenas de cúbits lógicos resolvieron dinámicas imposibles de simular clásicamente con precisión equivalente. Esto interesa sobre todo a la química computacional y la ciencia de materiales, no a aplicaciones de negocio general.

El otro campo con avance real es la criptografía poscuántica, aunque aquí el empuje viene del miedo más que del progreso cuántico real. En agosto de 2024 el NIST finalizó los primeros estándares poscuánticos: ML-KEM para intercambio de claves, ML-DSA y SLH-DSA para firmas. A lo largo de 2025 la industria ha ido integrándolos: TLS 1.3 con híbrido X25519MLKEM768 ya es el predeterminado en Chrome y Firefox, OpenSSH 10 añadió soporte nativo, y los proveedores de nube han empezado a ofrecerlos en sus servicios de gestión de claves. El algoritmo de Shor, el que rompería RSA y curvas elípticas, sigue necesitando cientos de miles de cúbits lógicos de alta fidelidad, muy lejos de lo que hay. Pero el principio de cosechar datos cifrados hoy para descifrarlos mañana ha movido suficiente presión regulatoria como para que la migración sea prioridad real en infraestructura crítica.

Las promesas que siguen sin cumplirse

Hay que decir con claridad lo que en 2026 sigue siendo investigación, no producto. El machine learning cuántico, con toda su literatura académica, no ha demostrado ventaja clara sobre métodos clásicos en tareas útiles, y varios resultados teóricos recientes sugieren que las ventajas que parecían existir desaparecen al cuantificar bien el coste de cargar datos clásicos en estados cuánticos. Los algoritmos de optimización cuántica para problemas de negocio, como los que prometían revolucionar las finanzas y la logística, siguen siendo demostraciones de laboratorio sin producción seria.

La criptoanálisis cuántico, es decir, romper RSA con Shor, sigue a una distancia que varios grupos académicos estiman entre diez y veinte años, y que podría ser más. Las estimaciones son sensibles a suposiciones sobre la calidad futura de los cúbits y la eficiencia de los códigos de corrección, y las estimaciones más recientes tienden a ser más conservadoras, no menos. Esto no cambia que hay que migrar a poscuántica ahora, pero sí matiza la urgencia respecto a la narrativa de hace tres años.

El último punto donde conviene bajar expectativas es el uso comercial. Las empresas que en 2020 anunciaron laboratorios cuánticos han pasado por ciclos de reestructuración y varios proveedores se han consolidado. El mercado real de acceso a máquinas cuánticas es todavía pequeño, dominado por investigación académica, algunas farmacéuticas explorando simulación molecular, bancos con proyectos piloto que casi siempre acaban siendo mejor con métodos clásicos, y agencias gubernamentales con intereses estratégicos. No es un mercado masivo ni lo será en los próximos años.

Cómo pensar la decisión

Mi lectura para un equipo técnico o directivo en 2026 es que la computación cuántica merece atención vigilante pero no inversión operativa salvo en nichos muy concretos. Si trabajas en química computacional, ciencia de materiales o farmacéutica con problemas de simulación fuera del alcance clásico, tiene sentido dedicar presupuesto a exploración activa: el progreso es real y los cúbits lógicos empiezan a permitir experimentos que hace tres años eran imposibles. Si trabajas en infraestructura crítica, migración a criptografía poscuántica sí es prioridad urgente, independientemente de cuándo llegue la máquina capaz de romper RSA, porque la ventana de cosecha de datos ya está abierta.

Para el resto, la posición razonable es informarse sin invertir. Seguir los anuncios técnicos importantes, entender el vocabulario de cúbits físicos frente a lógicos, saber qué es ML-KEM y por qué importa, pero no dedicar tiempo ni presupuesto a pilotos especulativos. La tecnología está en un punto intermedio donde hay progreso genuino pero la aplicación sigue siendo estrecha, y las empresas que más se beneficiarán en los próximos cinco años serán aquellas con problemas cuánticos nativos, no aquellas buscando usos forzados para una tecnología que todavía no resuelve su caso.

El balance honesto de 2026 es este: la computación cuántica ha dejado de ser vaporware sin dejar de ser investigación. Hay hardware que funciona, hay cúbits lógicos que corrigen errores, hay experimentos con valor científico real. No hay ventaja económica masiva, no hay aplicaciones de consumo, no hay la revolución que vendían las diapositivas de 2019. Saber distinguir las dos cosas es probablemente más valioso hoy que cualquier predicción sobre dentro de cinco años.